Claude Code y Claude Opus 4.6 detonaron una era dorada para los desarrolladores, que se encontraron con un agente de IA y un modelo fantásticos para su trabajo. De repente OpenAI ya no era la empresa de moda: lo era Anthropic, que enamoró a usuarios y desarrolladores y se convirtió en la niña bonita de la IA. Meses después estamos viendo cómo Anthropic está haciendo cambios que están siendo muy criticados y que apuntan a algo que ya hemos visto en repetidas ocasiones: las plataformas te conquistan e inevitablemente luego las plataformas te exprimen.

El detonante. El 2 de abril de 2026, Stella Laurenzo, Senior Director en el grupo de IA de AMD, publicó un texto en el repositorio de GitHub de Claude Code titulado «Claude Code es inútil para tareas de ingeniería complejas con las actualizaciones de febrero». Esta directiva incluyó un análisis meticuloso de casi 6.600 sesiones reales de Claude Code con cerca de 235.000 llamadas a herramientas y uns 18.000 bloques de razonamiento en cuatro proyectos distintos. Las conclusiones eran para ella obvias: el rendimiento de Claude Code y de Claude Opus 4.6 se habían degradado.

Anthropic dice que Claude Mythos es demasiado potente para hacerlo público. La pregunta es si esto no es más que un «que viene el lobo»

Los números. En ese análisis se muestran según Laurenzo dos periodos. En el periodo bueno, de enero a mediados de febrero, el modelo leía 6,6 archivos por cada archivo que editaba. En el periodo teóricamente degradado, de marzo en adelante, esa tasa había caído a 2,0 archivos leídos.

Las ediciones de código en ficheros que Claude no había revisado recientemente pasaron del 6,2% al 33,7%: uno de cada tres cambios al código los estaba haciendo «a ciegas». Además se redujo la visibilidad del razonamiento, de 2.200 caracteres a solo 600 de media, pero hay algo más. Los costes del proceso se multiplicaron por 122 en el mismo periodo, aunque es cierto que en ese periodo pasaron de usar 1-3 agentes concurrentes a usar 5-10, lo que complica la interpretación de los datos.

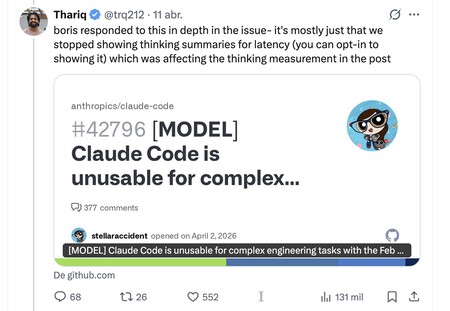

Anthropic trata de aclarar qué ha pasado. La respuesta oficial de Anthropic la publicó Boris Cherny, responsable de Claude Code. Este ingeniero confirmó dos cambios de producto reales: el 9 de febrero, Opus 4.6 pasó a usar el llamado «razonamiento adaptativo» por defecto. El 3 de marzo, el nivel de esfuerzo por defecto pasó de alto a medio, situándose en el nivel 85 que Anthropic describe como «el mejor equilibrio entre inteligencia, latencia y coste para la mayoría de los usuarios».

Debate cerrado. Cherny también habló de esa sospecha de que ahora Claude estaba ocultando «cómo pensaba». Explicó que el cambio en los registros de razonamiento visible no es una degradación real, y la cabecera detectada era simplemente una modificación de la interfaz de usado que ocultaba el razonamiento intermedio para reducir la latencia sin afectar el rendimiento del modelo. La propia Laurenzo ya había previsto algo así e intentó implementar soluciones para evitarlo pero sus datos confirmaban esa caída de rendimiento. Cherny cerró el debate como dando por resuelta la cuestión, pero no parece que realmente lo esté.

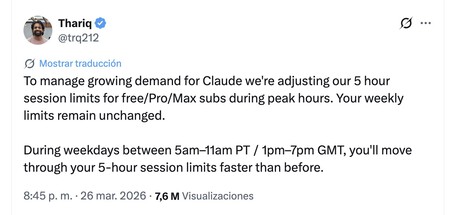

Crisis de capacidad de cómputo. Thariq Shihipar, del equipo de Claude Code, reveló en marzo que Anthropic estaba ajustando los límites de sesión de 5 horas durante las horas pico. Es decir: si había mucha demanda, tus tokens de Claude probablemente se agotarían más rápido. Señaló que la medida en realidad solo la notarían el 7% de los usuarios (los más intensivos en esas horas punta), y confesó que «sé que esto es frustrante. Seguiremos invirtiendo en escalar la eficiencia». Eso se contradice con un comentario en el debate sobre el post de Laurenzo en el que explicó que «no degradamos nuestros modelos para servir mejor la demanda, lo he dicho muchas veces con anterioridad».

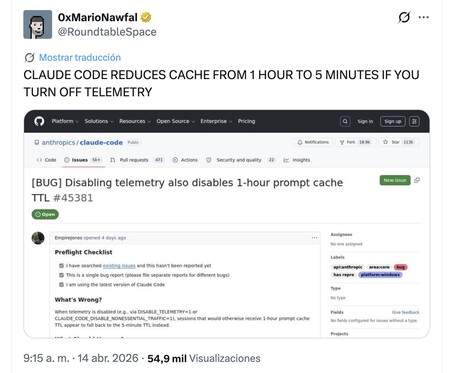

Más degradaciones. Aparecieron otros descubrimientos y críticas, como el de cómo la caché de prompts de Claude Code también se había reducido de forma drástica (de una hora a cinco minutos), disparando el consumo de cuota en sesiones largas de programación. Anthropic le indicó a VentureBeat que las cuentas Team y Enterprise no se ven afectadas por esos límites de sesión, pero el patrón parece cada vez más claro: el cómputo escasea y hay que racionarlo… o al menos eso es lo que parecen apuntar todas estas medidas de Anthropic. Lo que sigue sin estar claro es si la calidad del modelo realmente se ha visto degradada, aunque hay «megahilos» de Reddit que apuntan también a esa dirección.

De «nerfing», nada. Que una empresa degrade su servicio de forma premeditada se suele llamar «nerfing» en redes sociales, y las críticas en este sentido se fueron disparando en el caso de Anthropic. Numerosas publicaciones de usuarios en X y en medios de tecnología han hecho referencia al estudio de Laurenzo y acusaban a Anthropic de esa degradación volunaria de sus modelos. Boris Cherny intervino al menos en un caso para decir tajantamente que «Eso es falso» y para explicar que informaron de los cambios y de hecho dieron la opción a los usuarios de desactivarlo.

Pero el racionamiento existe. En The Wall Street Journal confirmaban que ese racionamiento del cómputo está ciertamente produciéndose entre las plataformas de IA debido a la alta demanda. Un buen ejemplo de las consecuencias lo tenemos en David Hsu, fundador y CEO de Retool. Explicó en dicho diario que aunque prefería Claude Opus 4.6 para potenciar su agente de IA, tuvo que cambiar recientemente al modelo de OpenAI porque «Anthropic no para de caerse todo el tiempo».

Los precios cambian (silenciosamente). The Information indicó ayer que Anthropic está cambiando la forma de facturar a los usuarios de los planes Enterprise. En lugar de una suscripción de 200 dólares al mes con una «tarifa plana» de uso de sus modelos de IA, lo que harán será cobrar una tarifa base de 20 dólares por usuario y mes y a eso le sumarán el consumo de cada usuario con el precio estándar de su API. Su propia documentación actualizada lo señala («El uso nno está incluido en la tarifa por asiento») y se estima que el cambio puede doblar o incluso triplicar el coste usar Claude para usuarios intensivos. Desaparecen además los descuentos del 10 al 15% de la API que se incluían en el pasado y que permitían a las empresas escalar ese consumo de tokens de forma más asequible. Los precios por millón de tokens no han cambiado, pero pasamos de una «tarifa plana» (con cuotas de uso) a un modelo de pago por uso, mucho más caro para usuarios intensivos.

No es solo Anthropic. El movimiento de esta empresa no es algo aislado. OpenAI cambió los precios de Codex para alinearlo con el uso de tokens de API en lugar de facturar por mensaje. GitHub publicó en su registro de cambios que actualizaba los límites para equilibrar la capacidad porque el uso intensivo «provoca tensión en nuestra infraestructura compartida». En marzo la plataforma Windsurf eliminó su sistema de créditos en favor de cuotas diarias y semanales, algo que fue criticado por los desarrolladores que usaban el anterior sistema de facturacion «flexible». Replit hizo un cambio similar que también fue muy comentado en redes sociales.

La barra libre se acabó. Las empresas de IA están dándose cuenta de que la demanda está creciendo más rápido de lo que pueden asumir, y están ajustando la forma en la que ofrecen sus modelos y servicios para ajustarse a esa demanda. Lo malo es que para los usuarios y desarrolladores el efecto está siendo el mismo: o sus tokens se les acaban antes, o perciben que la IA ya no es tan buena como antes.

En Xataka | La “economía de los tokens” se ha roto: las tarifas planas de IA para programar son matemáticamente insostenibles

–

La noticia

Anthropic fue el «don’t be evil» de la IA para los desarrolladores. Ahora los está exprimiendo a todos

fue publicada originalmente en

Xataka

por

Javier Pastor

.

Fm Golfo Azul Villa Pehuenia

Fm Golfo Azul Villa Pehuenia